Sommaire

Les archives fossiles révèlent qu’il y a environ 2,6 millions d’années, les premiers humains ont compris l’intérêt d’utiliser des pierres pour marteler, couper et accomplir d’autres tâches essentielles à leur survie. Ces outils en pierre représentent les toutes premières inventions connues. Depuis cette époque, l’humanité n’a cessé d’inventer, faisant progresser la technologie et créant des solutions pour augmenter la production alimentaire, effectuer des calculs rapides, voyager vers des contrées lointaines ou encore combattre les maladies.

Toutefois, l’invention ne se limite pas aux seuls objets tangibles : elle englobe aussi des idées inédites ou des méthodes plus efficaces qui s’appuient parfois sur des innovations antérieures. Par nature, ces découvertes ont souvent pour but d’améliorer la condition humaine.

Cependant, même créées avec les meilleures intentions, les inventions peuvent s’avérer être des armes à double tranchant. Certaines offrent des solutions puissantes tout en exploitant les ressources naturelles limitées de notre planète. D’autres réglant efficacement des problèmes urgents peuvent engendrer des conséquences imprévues et souvent néfastes. Un exemple marquant est celui de la thalidomide, d’abord considérée comme sûre pour les femmes enceintes afin de soulager les nausées matinales et améliorer le sommeil. Des recherches ultérieures ont révélé que plus de 10 000 enfants sont nés avec de graves malformations, ou sont décédés quelques mois seulement après leur naissance, provoquant une refonte radicale des protocoles de tests et de régulation des médicaments.

De nombreux cas similaires d’innovations aux effets délétères confirment une leçon essentielle : en cas d’usage abusif, de mauvaise gestion ou de développement insuffisant, même les inventions les plus prometteuses peuvent entraîner des coûts imprévus et parfois causer plus de tort que de bien.

Le développement des armes nucléaires est né de la découverte de la fission nucléaire, un phénomène où la division du noyau d’un atome libère une énergie colossale. Les États-Unis furent les premiers à exploiter cette énergie à des fins militaires et restent à ce jour la seule nation à avoir utilisé des armes nucléaires en combat.

Rapidement, la démonstration de la puissance dévastatrice d’un missile nucléaire a déclenché une course effrénée entre quelques grandes puissances pour développer leur propre arsenal nucléaire. Parallèlement, de nombreux pays plaident pour la disparition totale de ces armes, jugées trop dangereuses pour l’humanité. Ainsi, la Chine, la France, l’Inde, la Corée du Nord, le Pakistan, la Russie et le Royaume-Uni ont officiellement reconnu l’existence de programmes nucléaires. L’Afrique du Sud, quant à elle, a conçu ses propres armes nucléaires dans les années 1970, mais a démantelé son programme complètement en 1991, faisant figure d’exception.

Les conséquences catastrophiques des essais et de l’utilisation d’armes nucléaires sont bien documentées. Elles affectent non seulement la vie humaine, mais également l’environnement et l’ensemble des organismes vivants. L’actualité récente le montre : le conflit Israël-Iran de 2025, où Israël a frappé des installations militaires iraniennes afin d’empêcher la production d’une bombe nucléaire, témoigne de l’instabilité engendrée par la simple existence de ces armes. La menace nucléaire reste ainsi un facteur de tension permanente dans les relations internationales, malgré les discours sur la paix qu’elle est censée garantir.

Au début du XXe siècle, des scientifiques ont découvert qu’en ajoutant de l’hydrogène, les huiles végétales liquides pouvaient rester dans un état semi-solide, même sans être congelées ou réfrigérées. Ce procédé, appelé hydrogénation partielle, a permis aux fabricants de prolonger la durée de conservation des aliments tout en améliorant leur apparence, leur texture et leur goût.

Grâce au fait que les ingrédients contenant des huiles partiellement hydrogénées, comme la margarine, étaient moins coûteux que le beurre ou le saindoux, ils sont rapidement devenus incontournables dans de nombreux produits de boulangerie industriels et snacks.

Toutefois, l’hydrogénation partielle ne modifie pas tous les liens chimiques des huiles, ce qui entraîne la formation d’acides gras trans, communément appelés « trans fats ». Dès les années 1990, les chercheurs ont établi des liens préoccupants entre la consommation de ces graisses trans et plusieurs problèmes de santé majeurs, notamment l’augmentation du cholestérol LDL (le « mauvais » cholestérol) favorisant les maladies cardiovasculaires, l’obésité et le diabète.

De plus, les aliments ultra-transformés contenant des huiles partiellement hydrogénées sont souvent riches en calories, sucres, graisses ou sodium, ce qui aggrave encore les risques sanitaires liés à leur consommation.

En 2015, la Food and Drug Administration américaine a officiellement reconnu que les graisses trans ne sont « généralement pas considérées comme sûres » et a recommandé aux fabricants alimentaires de cesser de les utiliser. Malgré les campagnes renforcées de l’Organisation mondiale de la santé et d’autres associations, les graisses trans n’ont pas encore totalement disparu des rayons.

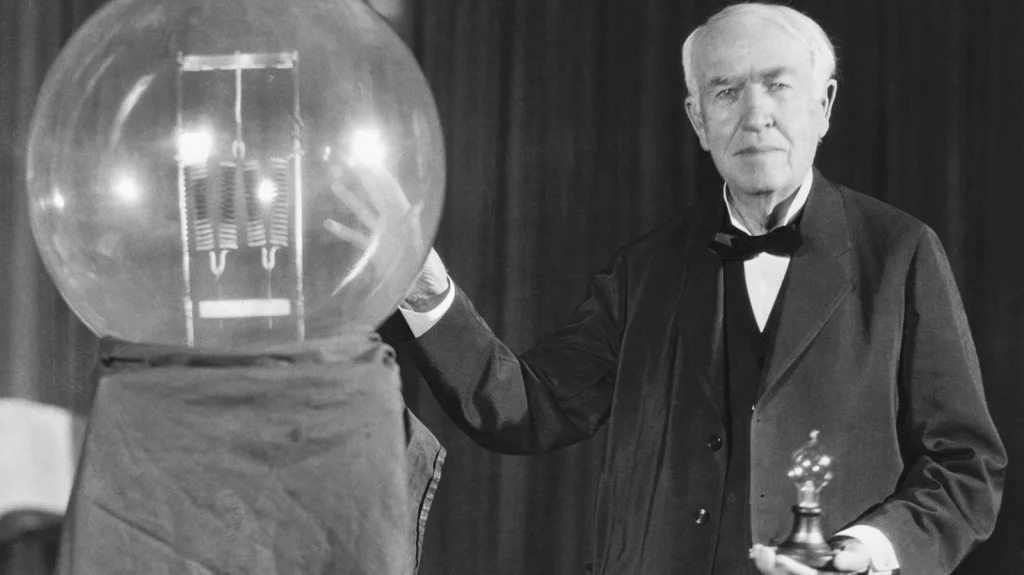

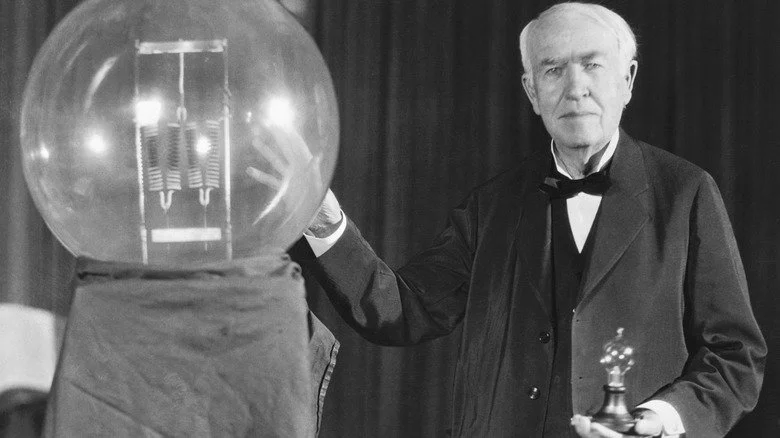

Imaginez un monde totalement dépourvu d’éclairage électrique, ou même d’éclairage artificiel. L’invention et la généralisation des lumières artificielles — depuis les lampes alimentées au gaz de houille du XVIIIe siècle jusqu’aux lampes fluorescentes et aux diodes électroluminescentes (LED) actuelles — ont profondément transformé notre manière de vivre et de travailler. La nuit ne plonge plus les rues dans une obscure obscurité, permettant de réaliser des activités après le coucher du soleil et réduisant, en apparence, les risques liés à la criminalité nocturne.

Pourtant, cette flexibilité accrue et ce sentiment de sécurité ont un revers environnemental et sanitaire. Le phénomène de pollution lumineuse perturbe nos rythmes biologiques, notamment l’horloge interne et les cycles veille-sommeil, tout en réduisant notre capacité à contempler la beauté des étoiles au firmament. Une revue de 2015 portant sur 85 études, publiée dans Chronobiology International, souligne que l’exposition à la lumière artificielle nocturne (ALAN) accroît le risque de cancers du sein chez l’humain. Une exposition chronique peut aussi entraîner des effets délétères sur le cerveau, le cœur et le métabolisme.

Par ailleurs, un article scientifique de 2018 dans Ecology & Evolution met en lumière l’impact négatif de l’ALAN sur les insectes nocturnes. Cette perturbation affecte leurs capacités de navigation, les rend plus vulnérables aux prédateurs, et peut même causer leur cécité. Ainsi, malgré ses avantages apparents, l’éclairage artificiel soulève des questions majeures en matière d’écosystèmes et de santé publique.

Chlorofluorocarbures (CFC)

Au début du XXe siècle, les climatiseurs et réfrigérateurs domestiques utilisaient des réfrigérants tels que l’ammoniac, le dioxyde de soufre et le propane, des substances potentiellement mortelles en cas de fuite. Pour trouver une alternative plus sûre, une équipe de chercheurs financée par l’industrie, dont l’ingénieur chimiste Thomas Midgley Jr. (également inventeur de l’essence plombée), a mis au point un nouveau composé : le dichlorodifluorométhane, communément appelé Freon-12, un type de CFC.

Rapidement, le Freon-12 devint le réfrigérant privilégié des fabricants d’appareils américains et fut même imposé comme seul fluide frigorigène autorisé dans les bâtiments publics. Sa réputation de sécurité et son coût de production relativement bas encouragèrent par ailleurs l’usage des CFC comme propulseurs dans les aérosols (laques, peintures, etc.). Dès les années 1970, la production mondiale atteignait près d’un million de tonnes par an.

Cependant, cette adoption massive ne tarda pas à révéler un effet secondaire inattendu. Dans la stratosphère, les CFC sont décomposés par les rayons ultraviolets du soleil, déclenchant une réaction chimique destructrice capable de dégrader la couche d’ozone. Cette couche protège la Terre des radiations solaires nocives, agissant comme un bouclier invisible essentiel à la vie.

En 1985, une étude publiée dans la revue Nature dévoila un trou dans la couche d’ozone au-dessus de l’Antarctique, lié à l’usage intensif des CFC. Cette découverte conduisit à la signature du Protocole de Montréal en 1987, visant à éliminer progressivement ces substances.

Néanmoins, le problème persiste : une recherche publiée en 2023 dans la même revue a révélé une augmentation mondiale des concentrations de CFC entre 2010 et 2020, soulignant que les effets de cette invention continuent d’impacter la santé environnementale à l’échelle planétaire.

Le sirop de maïs à haute teneur en fructose

Bien que le sirop de maïs classique et le sirop de maïs à haute teneur en fructose soient tous deux issus du maïs, ils diffèrent par un élément essentiel. Le sirop de maïs traditionnel doit sa douceur principalement au glucose, moins sucré que le sucre de table (saccharose). Afin de créer un substitut de sucre plus économique et plus sucré, l’industrie alimentaire y ajoute des enzymes qui transforment une partie du glucose en fructose, un sucre plus sucré que le glucose et le saccharose. C’est la raison pour laquelle le sirop de maïs à haute teneur en fructose se retrouve fréquemment dans la liste des ingrédients de nombreux produits, tels que pâtisseries, sodas, jus et condiments vendus en supermarché.

Cependant, les scientifiques tirent la sonnette d’alarme sur les conséquences potentiellement nocives d’une consommation excessive de ce sucre. Selon la diététicienne agréée Kate Patton, le sirop de maïs à haute teneur en fructose peut stimuler une production accrue de graisses dans le foie. « Notre organisme ne peut absorber et utiliser qu’une certaine quantité de graisse. Le surplus est alors stocké sous forme de triglycérides, sortes de graisses circulant dans le sang, ou de masse grasse corporelle », explique-t-elle. Cette accumulation de graisses est liée à une élévation des risques de maladies cardiovasculaires, de diabète, ainsi qu’à une hausse de la pression artérielle et du taux de cholestérol.

Une étude publiée en 2017 dans la revue scientifique PLoS One a aussi relevé des corrélations entre la consommation de ce sirop et des troubles métaboliques, ainsi qu’une altération du fonctionnement de la dopamine, neurotransmetteur impliqué dans la motivation et le plaisir.

Cependant, ces effets néfastes nécessitent encore des recherches complémentaires pour être pleinement confirmés. Quoi qu’il en soit, la présence omniprésente du sirop de maïs à haute teneur en fructose dans les aliments ultra-transformés, souvent combinée à d’autres ingrédients de valeur nutritionnelle discutable, rend sa consommation modérée particulièrement difficile.

Peu importe le nombre de secrets troublants que l’on découvre sur les chaînes de restauration rapide, une vérité demeure : ce type d’alimentation est loin d’être sain. Pourtant, le plus inquiétant n’est peut-être pas son effet néfaste sur la santé, mais plutôt notre incapacité à renoncer à ces aliments malgré cette connaissance.

Pour beaucoup – professionnels pressés, personnes peu enclines à cuisiner ou adolescents affamés – la restauration rapide offre une solution pratique : une sélection quasi illimitée de plats savoureux, abordables et servis rapidement. Mais les études scientifiques montrent que ces repas chargés en calories, sucres, sodium, gras trans et autres substances nocives provoquent de nombreux troubles :

- hypertension artérielle,

- élévation du taux de sucre sanguin,

- inflammations,

- prise de poids excessive,

- détérioration du microbiote intestinal,

- carences nutritionnelles,

- risques accrus de maladies cardiovasculaires, démence, diabète et cancers divers.

Mais les impacts négatifs de la popularité de la restauration rapide ne se limitent pas à la santé. L’énorme quantité de déchets issus des emballages destinés à la vente à emporter représente une part importante des millions de tonnes de plastique générées annuellement, notamment aux États-Unis. En outre, ce modèle alimentaire peu onéreux a un coût sanitaire très élevé, estimé à plus de 50 milliards de dollars par an selon une étude publiée en 2019 dans PLoS Medicine.

Les plastiques synthétiques

Les plastiques synthétiques, communément appelés « plastiques », ont fait leur apparition au début du XXe siècle. À cette époque, les fabricants cherchaient une nouvelle matière première pour remplacer les ressources naturelles limitées telles que l’ivoire, les cornes ou la nacre. Résultat de la transformation de certains produits chimiques soumis à de fortes pressions et températures, le plastique s’est rapidement imposé comme une solution durable, peu coûteuse et facile à produire en masse.

Au fil des décennies, les recherches ont permis de développer diverses formulations de plastique, ouvrant la voie à une multitude de produits variés. Cette matière semblait promise à un avenir durable… mais cette pérennité s’est avérée être une malédiction.

En effet, les produits plastiques figurent parmi les matériaux les plus longs à se décomposer dans l’environnement. Par exemple, un sac plastique met en moyenne vingt ans avant de se dégrader, tandis que des objets comme les brosses à dents, les couches jetables ou les dosettes de café peuvent persister jusqu’à 500 ans. Cette accumulation de déchets plastiques dans les océans, les forêts ou les milieux urbains et ruraux perturbe gravement les écosystèmes, menace la faune et engage des conséquences alarmantes pour la santé humaine. La fabrication et l’incinération du plastique contribuent également au changement climatique, accentuant encore davantage ce fléau planétaire.

Mais le problème ne s’arrête pas à la dégradation des objets plastiques. Ceux-ci se fragmentent en microplastiques, ces particules microscopiques invisibles à l’œil nu, qui contamineront partout : dans l’eau potable, dans notre organisme et même jusqu’en Antarctique, un lieu exempt de populations humaines permanentes.

Si vous avez déjà ressenti que, malgré vos meilleures intentions, vos actions aggravent les choses, souvenez-vous de l’histoire de Thomas Midgley Jr., un inventeur que le magazine New Scientist a surnommé à juste titre « une catastrophe environnementale à lui seul ». Ingénieur chimiste, Midgley est à l’origine, entre autres, des composés chlorofluorocarbonés (CFC), mais c’est surtout pour avoir conçu l’essence plombée qu’il est tristement célèbre.

Dans les années 1920, alors employé chez General Motors, il a mis au point le procédé d’ajout de tétraéthylplomb dans l’essence afin d’améliorer les performances des véhicules et d’éliminer le cliquetis des moteurs souffrant de mauvaises combustions. Malgré les avertissements de scientifiques, de médecins et d’experts en plomb, Midgley affirmait que ce carburant était sans danger, allant jusqu’à déclarer que « la rue moyenne sera probablement si exempte de plomb qu’il sera impossible de le détecter ou d’observer son absorption ».

À cette époque, l’absence de preuves empiriques démontrant un risque réel, combinée à une méconnaissance partielle des effets toxiques du plomb, permit à l’essence plombée d’être rapidement adoptée à travers le monde. Cependant, les recherches ultérieures ont démenti ces propos : les émissions provenant des véhicules utilisant ce carburant étaient en réalité un poison gazeux causant de graves problèmes de santé à grande échelle urbaine.

Les enfants exposés à cette pollution présentaient notamment des troubles du développement cognitif. Face à ces conséquences dramatiques, de nombreux pays ont progressivement interdit l’essence plombée, la dernière interdiction en date ayant eu lieu en Algérie en 2021.

DDT

Bien que le dichlorodiphényltrichloroéthane (DDT) ait été synthétisé pour la première fois en 1874, son potentiel en tant qu’insecticide n’a été reconnu qu’en 1939 grâce aux travaux de Paul Hermann Müller, chimiste suisse. Présenté comme un puissant tueur d’insectes, le DDT a rapidement trouvé sa place tant chez les agriculteurs que dans les foyers. Il a connu une utilisation massive pendant la Seconde Guerre mondiale et a continué d’être l’insecticide privilégié aux États-Unis pendant plusieurs décennies.

Sa capacité à réduire drastiquement la propagation de maladies transmises par les insectes, telles que la fièvre jaune, le typhus ou le paludisme, lui a valu le surnom de « bienfaiteur de l’humanité » et permis à Müller de recevoir le prix Nobel de physiologie ou médecine en 1948.

Cependant, le DDT s’est avéré être mortel non seulement pour les insectes, mais également pour de nombreuses autres espèces animales et pour l’homme. Très toxique pour la faune marine et les oiseaux, il a contribué à la quasi-extinction de plusieurs espèces emblématiques comme le pygargue à tête blanche et le faucon pèlerin. Par ailleurs, il nuit gravement au développement du fœtus et accroît le risque de certains cancers.

Un des problèmes majeurs du DDT est sa stabilité : non biodégradable, il s’accumule dans les réserves de graisse, persistant ainsi dans l’organisme sur le long terme. Ces découvertes ont conduit les défenseurs de l’environnement à lutter pour interdire son usage, en particulier l’américaine Rachel Carson, dont le livre « Printemps silencieux » (1962) a dénoncé les dangers de ce produit chimique synthétique.

Quelques années après la publication de cet ouvrage, les États-Unis ont officiellement banni l’emploi du DDT en agriculture, marquant un tournant dans la prise de conscience mondiale des risques associés à cette invention. Ce cas illustre parfaitement comment des avancées scientifiques, initialement porteuses d’espoir, peuvent engendrer des conséquences désastreuses quand leurs impacts environnementaux et sanitaires sont sous-estimés.

Il est aujourd’hui difficile d’imaginer un monde sans réseaux sociaux. L’humanité a parcouru un long chemin depuis les mails et les groupes de discussion USENET des années 1970. Désormais, ces plateformes permettent aux utilisateurs de constituer leur portfolio professionnel, de renouer avec des amis du lycée qu’ils n’ont pas vus depuis vingt ans, ou encore de partager de courtes vidéos souvent spontanées et sans filtre.

Les réseaux sociaux ont joué un rôle crucial pendant la pandémie de COVID-19, facilitant le maintien des relations malgré la distanciation sociale, la promotion des biens et services, ainsi que la diffusion d’informations vitales sur la situation extérieure.

Cependant, comme toute personne ayant un compte sur ces plateformes le sait, l’expérience n’est pas toujours idyllique. Les réseaux sociaux sont infestés de « trolls » — ces utilisateurs qui déclenchent des conflits ou publient des commentaires incendiaires dans le seul but de provoquer des réactions. Ils favorisent également la propagation massive de fausses informations. Une étude publiée en 2023 dans Computers in Human Behavior rappelle que la désinformation n’est pas un phénomène nouveau, mais souligne combien les réseaux sociaux ont révolutionné la capacité à créer et diffuser rapidement des mensonges à grande échelle.

De plus, l’impact des réseaux sociaux sur la santé mentale des jeunes adultes est loin d’être négligeable. Une revue systématique parue en 2023 dans Cureus établit un lien entre l’utilisation intensive des réseaux sociaux et une augmentation des cas de dépression, d’anxiété et de stress chez les adolescents et jeunes adultes.

La consommation récréative du tabac existe depuis plusieurs millénaires, bien avant l’apparition de la cigarette telle que nous la connaissons aujourd’hui. Cependant, l’invention des machines à rouler les cigarettes à la fin du XIXe siècle a entraîné une explosion de leur popularité. Cette production de masse accrue, combinée à l’absence d’études scientifiques rigoureuses à l’époque sur les méfaits du tabac, a permis aux fabricants et aux publicitaires de présenter la cigarette comme une activité saine, virile et sans grand danger.

Mais dès le milieu du XXe siècle, un nombre croissant de preuves scientifiques a mis en lumière les graves conséquences du tabagisme sur la santé humaine. En 1964, le rapport du chirurgien général des États-Unis a établi sans équivoque que le tabagisme augmentait considérablement le risque de cancer du poumon, notant une mortalité supérieure de 70 % chez les fumeurs par rapport aux non-fumeurs. Aujourd’hui, des décennies d’études confirment que le tabac impacte négativement presque toutes les parties du corps.

En dépit de ces connaissances, on estime qu’aux États-Unis, plus de 480 000 décès chaque année sont directement liés au tabagisme ou à l’exposition au tabagisme passif, ce dernier touchant près d’un quart de la population mondiale.

De plus, les cigarettes électroniques, invention récente destinée à aider à l’arrêt du tabac, ont aussi montré des effets délétères sur la santé. Les autorités sanitaires insistent clairement : « Aucun produit du tabac, y compris les cigarettes électroniques, n’est sûr. »